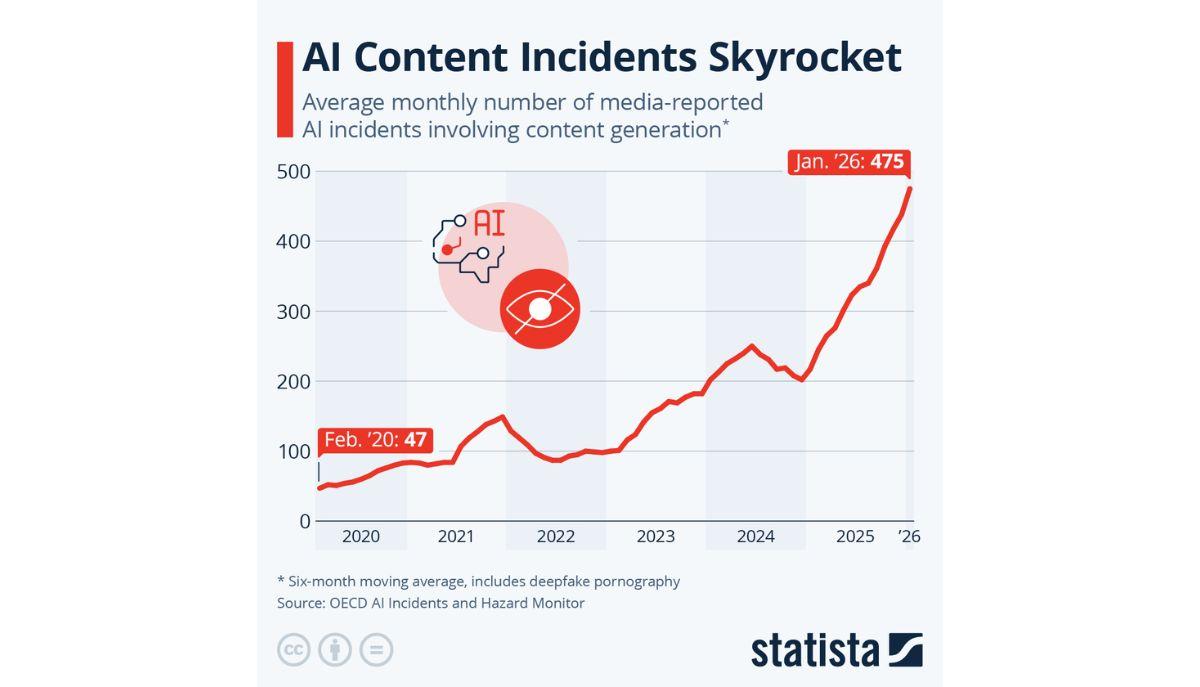

L’intelligenza artificiale corre fortissimo, ma con lei aumentano i rischi. Secondo gli ultimi dati dell'OECD, gli incidenti legati ai contenuti AI sono decuplicati negli ultimi sei anni, passando da 50 a quasi 500 casi mensili segnalati a inizio 2026.

Per noi studenti la situazione è delicata: circa 1 adolescente su 17 (6%) — come riportato da Thorn, organizzazione non profit per la sicurezza dei minori — ha riferito di essere stato vittima di manipolazioni tecnologiche, come la creazione di immagini di nudo deepfake non consensuali. L'AI è uno strumento pazzesco, ma il confine tra utilità e pericolo non è mai stato così sottile.

Indice

Un’esplosione di contenuti (e di rischi)

Non è solo una tua impressione: i social che usi ogni giorno — da TikTok a Instagram, passando per YouTube — sono inondati di contenuti sintetici. Se nel 2020 i problemi erano rari, oggi la crescita è esponenziale. Il motivo? Due terzi degli studenti (Generazione Z e Alpha) usano regolarmente i chatbot, e il 30% lo fa ogni singolo giorno (Pew Research Center, 2025). Questa familiarità ci rende esperti, ma anche più esposti a chi usa l'AI per scopi dannosi, come la disinformazione mirata o i contenuti offensivi.

Deepfake: quando l'immagine diventa un'arma

Il dato più preoccupante riguarda i deepfake non consensuali. Essere presi di mira da un video creato artificialmente che sembra reale può avere conseguenze pesantissime. Oltre l'80% dei ragazzi intervistati da Thorn ha confermato che queste manipolazioni causano danni psicologici e sociali reali e permanenti.

Sai distinguere il vero dal falso?

A quanto pare, nemmeno gli adulti se la cavano bene. Uno studio pubblicato su PubMed Central nel 2026 evidenzia che la nostra capacità di identificare i contenuti sintetici varia drasticamente in base al formato:

- Video Deepfake: Il tasso di rilevamento oscilla tra il 60% e il 90%. La variabilità dipende dalla risoluzione e dalla complessità dei movimenti (spesso i "difetti" si notano nel bordo dei capelli o nel riflesso degli occhi).

- Voci Sintetiche: È la sfida più difficile. Spesso scambiate per reali, hanno un margine di errore che supera il 40%. Distinguere un clone vocale da una voce naturale è quasi impossibile per l'orecchio umano senza software di analisi spettrografica.

- Testi Generati: Con i modelli linguistici avanzati (LLM), la rilevazione basata sull'intuizione è ormai inaffidabile. Senza strumenti tecnici dedicati, distinguere un saggio scritto da un'AI da uno umano è diventato quasi impossibile.

Come difendersi: la tua "Cassetta degli Attrezzi"

Mentre gli algoritmi diventano sofisticati, l'unica vera difesa è il dubbio metodico. La sfida del 2026 non è smettere di usare l'AI, ma imparare a navigare in un mare digitale dove non tutto quello che vedi è accaduto davvero.

Guida pratica: come blindare i tuoi social

I deepfake hanno bisogno di "carburante": le tue foto e i tuoi video. Meno materiale di alta qualità lasci in giro, più sarà difficile clonare il tuo volto o la tua voce.

-

Chiudi le porte (Profilo Privato): Se il tuo profilo è pubblico, qualunque bot può scaricare i tuoi contenuti per addestrare un'AI. Vai in Impostazioni > Account Privato.

-

Controlla i follower: Fai pulizia. Se non conosci qualcuno nella vita reale, non ha motivo di avere accesso alla tua "libreria" di immagini.

-

Blocca il download dei video: Su TikTok, disattiva l'opzione "Download" in Privacy. Su Instagram, limita i Remix dei tuoi Reel.

-

Esercita il "Diritto di Opposizione": Meta usa i post pubblici per istruire la sua AI. Nel Centro sulla Privacy di Instagram/Facebook, invia la richiesta per negare l'uso dei tuoi dati per l'addestramento dei modelli.

-

Sicurezza dell'Account (MFA): Attiva sempre l'Autenticazione a due fattori. Se hackerano il tuo profilo, avranno accesso a tutto il tuo storico fotografico (il dataset perfetto per un deepfake).

-

Trucchi "Pro" anti-AI:

-

Watermark: Mettere una piccola scritta semitrasparente sulle foto "disturba" i pixel usati dagli algoritmi di sostituzione facciale.

-

Risoluzione Standard: Non caricare tutto in 4K se non serve. Più i dettagli sono nitidi, più il deepfake risulterà realistico.

-

FAQ Rapide

-

Cos'è un deepfake? Un contenuto (foto, video o audio) creato tramite AI per far sembrare che qualcuno abbia detto o fatto qualcosa di mai accaduto.

-

Cosa fare se vedo un contenuto AI offensivo? Non condividerlo (nemmeno per criticarlo) e segnalalo subito alla piattaforma. Parlane con un adulto di fiducia.

-

Posso accorgermi sempre se un'immagine è AI? No. Alcuni errori (dita strane, sfondi distorti) stanno scomparendo. La regola d'oro è: verifica sempre la fonte originale.

Accedi a tutti gli appunti

Accedi a tutti gli appunti

Tutor AI: studia meglio e in meno tempo

Tutor AI: studia meglio e in meno tempo