Instagram ha annunciato un importante aggiornamento dedicato alla sicurezza: la piattaforma invierà una notifica ai genitori che utilizzano la supervisione se i figli adolescenti cercano ripetutamente, in un breve arco di tempo, termini legati al suicidio o all'autolesionismo.

Il social network ricorda che sono già attive policy per bloccare ricerche di questo tipo. Tuttavia, se i tentativi diventano frequenti, scatterà la nuova misura di protezione prevista per gli Account per Teenager.

L'obiettivo è garantire che le famiglie siano informate tempestivamente su potenziali segnali di disagio, fornendo ai genitori gli strumenti e le risorse necessari per offrire il giusto supporto ai propri figli.

Indice

Come funzionano le nuove notifiche

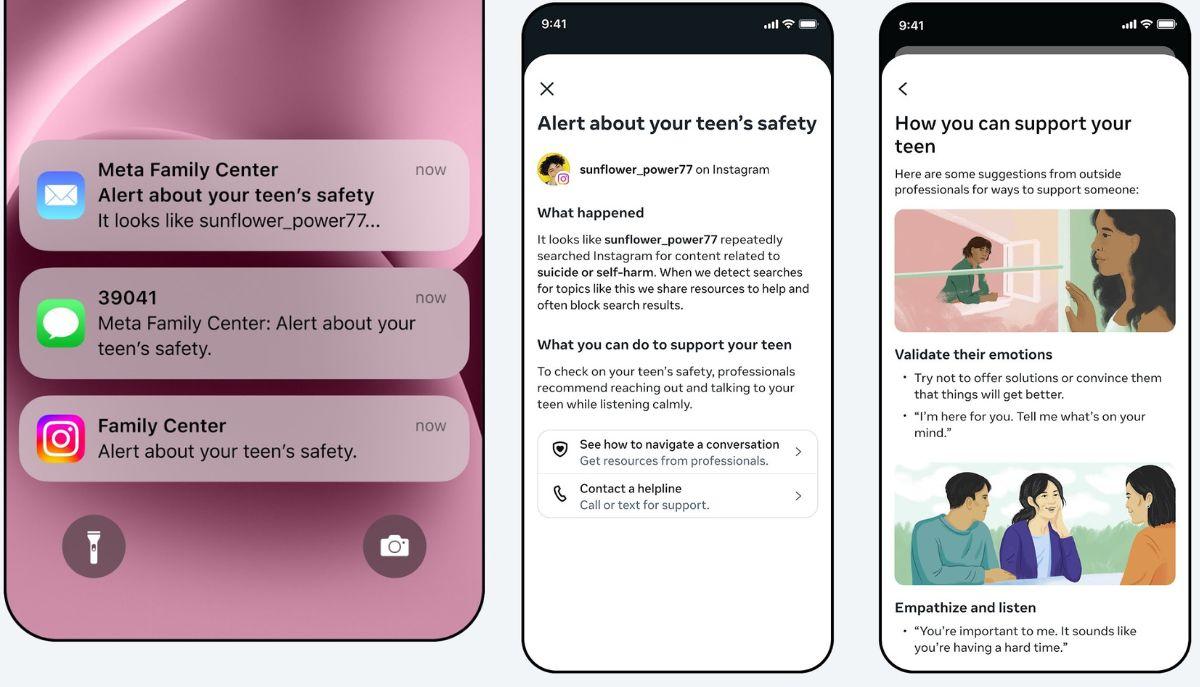

A partire dalla prossima settimana, i genitori e gli adolescenti che utilizzano le funzioni di supervisione riceveranno un’informativa su questo nuovo sistema di allerta. Le notifiche scatteranno quando le ricerche su Instagram includeranno termini legati al suicidio, all’autolesionismo o espressioni che indicano l’intenzione di compiere atti simili.

Le segnalazioni arriveranno ai genitori tramite e-mail, SMS o WhatsApp, oltre che con una notifica in-app. Selezionandola, si aprirà un messaggio a tutto schermo con i dettagli sulle ricerche effettuate dal minore.

I genitori avranno inoltre accesso a risorse di supporto, sviluppate in collaborazione con esperti, per imparare ad affrontare conversazioni così delicate. Il servizio debutterà negli Stati Uniti, nel Regno Unito, in Australia e in Canada, per poi essere esteso ad altri Paesi nel corso dell'anno.

Il criterio di attivazione

Per garantire un intervento tempestivo senza generare allarmismi inutili, Instagram ha collaborato con il Suicide and Self-Harm Advisory Group. Insieme hanno stabilito un criterio specifico: l'avviso viene inviato solo quando un adolescente effettua più ricerche sugli stessi temi in un breve arco di tempo.

L'approccio scelto è improntato alla massima prudenza. Ciò significa che, inizialmente, i genitori potrebbero essere avvisati anche in assenza di un pericolo reale. Questa fase di rodaggio servirà alla piattaforma per affinare l'algoritmo e trovare il giusto equilibrio tra protezione e accuratezza.

Un impegno costante per la sicurezza

Questa iniziativa si aggiunge alle misure già adottate da Instagram per proteggere gli adolescenti dai contenuti sensibili. La piattaforma applica da tempo policy rigorose contro la normalizzazione del suicidio o dell'autolesionismo: sebbene sia consentito agli utenti condividere le proprie esperienze personali, tali testimonianze vengono sistematicamente nascoste ai minori.

Attualmente, le ricerche di termini esplicitamente legati a questi temi vengono bloccate. In questi casi, Instagram non mostra alcun risultato, ma indirizza l'utente verso risorse di supporto e associazioni locali. Anche quando le ricerche indicano un disagio psicologico più generico, vengono comunque proposti strumenti di aiuto. Nei casi di rischio imminente per l'incolumità di una persona, la piattaforma attiva i servizi di emergenza, un intervento che nel tempo ha permesso di salvare numerose vite.

L'estensione all'Intelligenza Artificiale

I sistemi di AI di Instagram sono già progettati per fornire risposte adeguate e risorse d'aiuto. Oltre a questo, stanno arrivando notifiche per i genitori specifiche per le interazioni con l'AI.

L'obiettivo è informare le famiglie se un adolescente tenta di avviare conversazioni con l'intelligenza artificiale riguardanti il suicidio o l'autolesionismo. Si tratta di un ambito prioritario che richiede la massima responsabilità e su cui si continuerà a lavorare nei prossimi mesi.

.jpg)

Accedi a tutti gli appunti

Accedi a tutti gli appunti

Tutor AI: studia meglio e in meno tempo

Tutor AI: studia meglio e in meno tempo