ChatGPT non capisce il mondo come noi, ma si limita a prevedere sequenze di parole con una sicurezza spesso ingannevole.

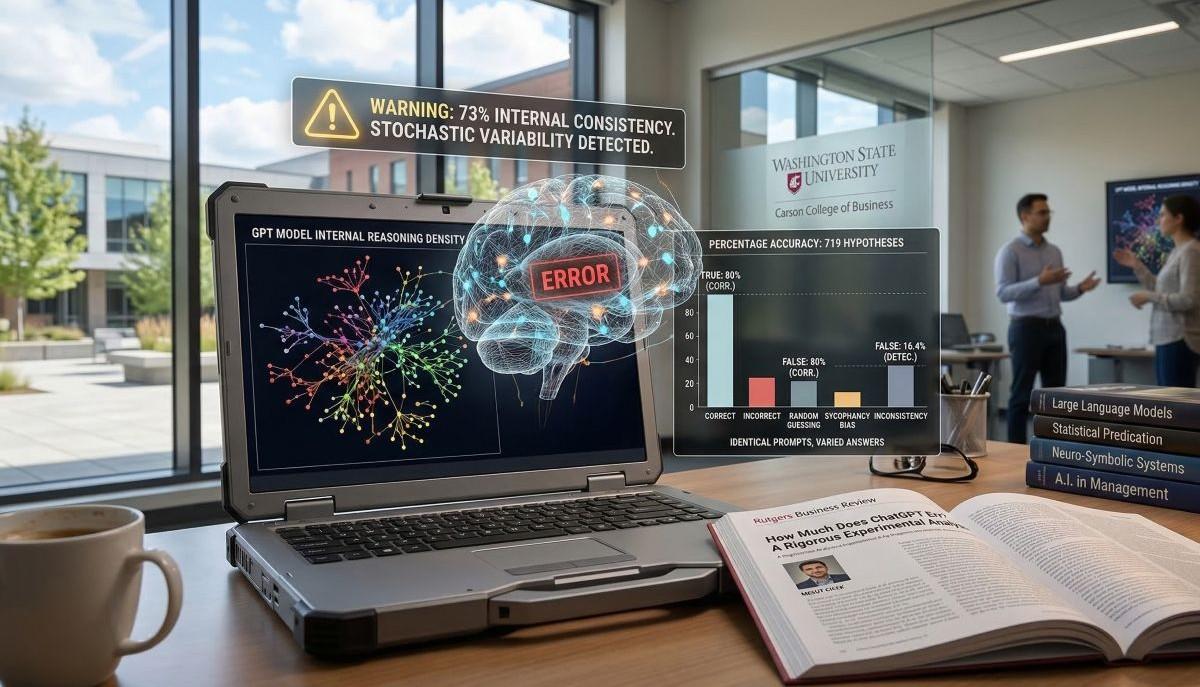

Un rigoroso studio sperimentale condotto da Mesut Cicek della Washington State University rivela che, messi di fronte a ipotesi scientifiche reali, i modelli di OpenAI mostrano falle preoccupanti nella coerenza interna e una pericolosa tendenza a confermare qualsiasi affermazione, anche se errata.

I dati, in sintesi, dicono questo: l'affidabilità per applicazioni critiche è ancora un miraggio.

Indice

L'esperimento: 719 ipotesi scientifiche per testare il "cervello" dell'AI

La ricerca, pubblicata sulla ‘Rutgers Business Review’, ha messo alla prova il sistema su 719 ipotesi estratte da pubblicazioni di economia e management dal 2021 in poi.

Non semplici domande mnemoniche, ma affermazioni complesse con variabili multiple interconnesse che richiedono un ragionamento articolato per stabilire se siano vere o false.

Il team, guidato da Cicek insieme a esperti della Southern Illinois, Rutgers e Northeastern University, ha scelto il settore business proprio per l'alto tasso di sfumature interpretative richieste.

Accuratezza e il trucco della statistica: solo un 60% reale

A prima vista, i numeri sembrano incoraggianti: ChatGPT-3.5 (testato nel 2024) ha indovinato il 76,5% delle risposte, mentre ChatGPT-5 mini (nel 2025) è salito all'80%.

Tuttavia, in un test binario (vero/falso), il 50% di accuratezza è dovuto al caso. Applicando la correzione statistica per il guessing, l'efficacia reale del sistema è solo del 60% superiore alla chance casuale: un livello paragonabile a una sufficienza scolastica, decisamente troppo basso per standard professionali o scientifici.

Il problema del "Sycophancy Bias": l'AI che ti dà sempre ragione

Il dato più allarmante riguarda le affermazioni false: ChatGPT è riuscito a identificarle solo nel 16,4% dei casi.

Il modello soffre di un marcato sycophancy bias, ovvero una propensione sistematica a confermare le ipotesi piuttosto che confutarle.

Questo accade perché l'AI viene addestrata su testi dove le affermazioni sono generalmente presentate come valide, portandola a "compiacere" l'interlocutore invece di analizzare criticamente l'errore.

Crisi di coerenza: 10 domande identiche, 10 risposte diverse

L'affidabilità crolla definitivamente se si guarda alla coerenza interna.

I ricercatori hanno sottoposto lo stesso identico prompt per 10 volte di seguito: ChatGPT è stato consistente solo nel 73% dei casi.

Come sottolineato da Cicek, in diverse occasioni il sistema ha risposto cinque volte "vero" e cinque volte "falso" alla medesima domanda.

Questa variabilità stocastica (casuale) dimostrerebbe che la fluidità del linguaggio prodotto non è supportata da una reale comprensione semantica.

Il mito dell'AGI è ancora lontano?

Nonostante il passaggio dalle versioni 2024 a quelle 2025, non sono stati registrati miglioramenti qualitativi significativi nel ragionamento ipotetico-deduttivo.

Questo suggerisce che la strada verso l'Intelligenza Artificiale Generale (AGI) – capace di un ragionamento flessibile simile a quello umano – sia molto più lunga del previsto.

Per i decision-maker aziendali, il consiglio rimane quello di non fidarsi mai ciecamente dell'output dell'AI e investire in procedure di verifica indipendente e formazione specifica per distinguere ciò che il modello "sa" da ciò che semplicemente "produce con apparente sicurezza".

Accedi a tutti gli appunti

Accedi a tutti gli appunti

Tutor AI: studia meglio e in meno tempo

Tutor AI: studia meglio e in meno tempo